Verifica en WhatsApp +34 644229319

Por Maldita.es

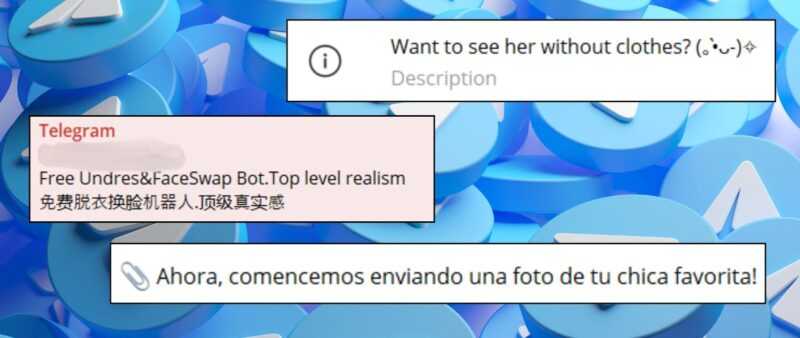

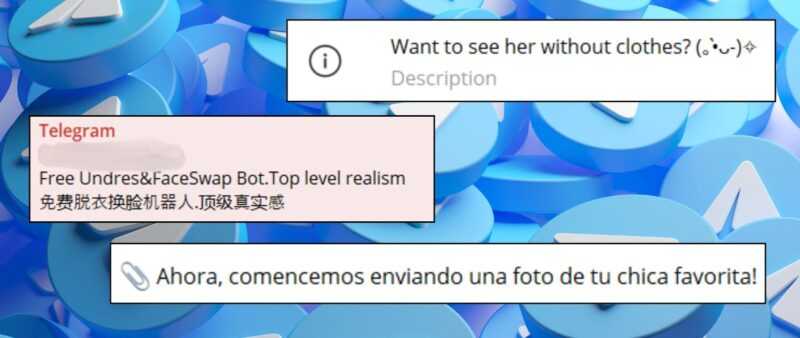

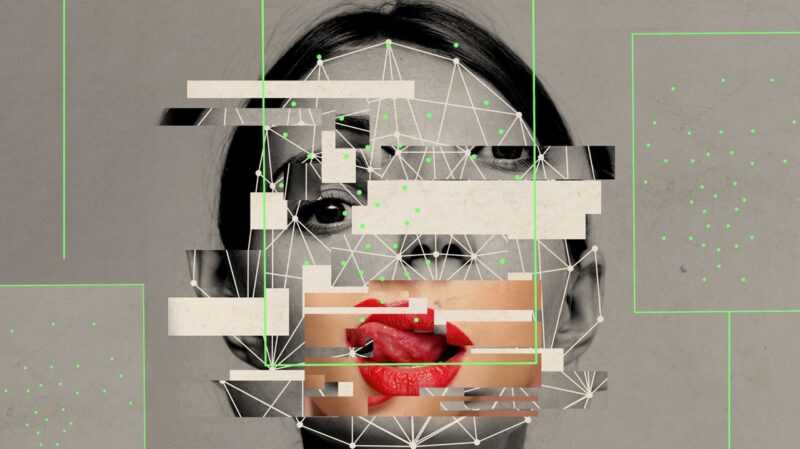

En Telegram existen bots que con inteligencia artificial pueden quitar la ropa a cualquier foto de una persona o ponerla como si estuviera en situaciones sexuales, sin su consentimiento.

Según un análisis realizado por Maldita.es, algunos de estos bots fomentan su uso a través de sorteos y recompensas por invitar a más usuarios, lo que les ayuda a aumentar su alcance e ingresos.

Los expertos consultados señalan que la falta de moderación y la facilidad para desarrollar estos bots favorecen su proliferación en Telegram, que debe eliminarlos si tiene conocimiento de su existencia, conforme a la Ley de Servicios Digitales (DSA) de la Unión Europea.

Maldita.es analizó

dos bots con más de 338 mil 600 usuarios mensuales en total, que ya han sido eliminados de la plataforma, y descubrió que utilizan

técnicas de gamificación para hacer que los usuarios volvieran a estas herramientas, una y otra vez.

Por ejemplo, los bots ofrecían comisiones o créditos a los usuarios si invitaban a sus amigos a utilizar la app. Uno de ellos realizaba sorteos diarios “con un premio máximo de cinco créditos”, además de dar bonificaciones por crear imágenes. El otro, ofrecía “regalos diarios” a sus usuarios.

Para acceder a sus servicios, los bots exigían a los usuarios unirse a un canal general donde se publicaban sorteos y actualizaciones. También requerían la aceptación de términos de uso, entre ellos, la prohibición de procesar imágenes de menores. Sin embargo, no se especificaba cómo verificaban su cumplimiento.

Te conviene leer: Deepfakes: Qué sabemos sobre los presentadores de noticias ficticios que se crean con IA y cómo podemos detectarlos

Estos bots aceptaban diversos métodos de pago, como PayPal, tarjeta de crédito e incluso criptomonedas. En uno de ellos, con 3 dólares (unos 62 pesos) se podían comprar 5.7 créditos, lo que permitía modificar unas siete imágenes.

Javi Cantón, investigador del Departamento de Ciencias de la Computación e Inteligencia Artificial de la Universidad de Granada, explicó a

Maldita.es que los administradores

obtienen beneficios de varias maneras, por ejemplo, a través de suscripción o pago para desbloquear funciones o expandiendo su red: “Aunque [Telegram] no tenga un beneficio directo,

se beneficia indirectamente al conseguir una mayor cantidad de usuarios activos, lo que incrementa el valor de su plataforma en términos de alcance y posicionamiento en el ecosistema digital”.

La laxitud en la moderación de contenidos y la facilidad para crear estos bots en Telegram son, según Cantón, las razones por las que proliferan estos bots en la plataforma de mensajería.

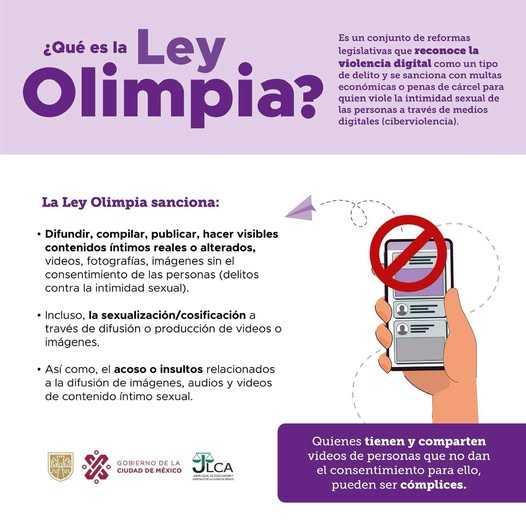

Según Wired, algunos de estos bots han sido utilizados para generar contenido sexual de menores, un delito penado en España por el Código Penal con de uno a tres años de prisión. Si las víctimas son adultas, puede suponer una vulneración del derecho al honor y a la imagen, y podría constituir un delito de injurias.

Sergio Carrasco, abogado e ingeniero en Telecomunicaciones e Informática, aclaró a

Maldita.es que

Telegram debe cumplir con la

Ley de Servicios Digitales (DSA) de la Unión Europea y eliminar estos bots

“una vez tenga conocimiento de su existencia”.

En España, la

responsabilidad recae sobre los usuarios que crean estos contenidos,

no sobre las herramientas.

Maite Sanz de Galdeano, abogada experta en protección de datos

indicó a Maldita.es que su comercialización puede considerarse

ilícita si no cumplecon la

Ley Europea de Inteligencia Artificial, que exigirá a los sistemas de IA generativa que identifiquen sus contenidos como creados con inteligencia artificial, además de prevenir la creación de contenidos ilegales.

La educación, la regulación y una mayor moderaciónde contenidos son claves para frenar esta preocupante tendencia. Los expertos recomiendan fomentar la conciencia social sobre los riesgos de compartir este tipo de contenidos.

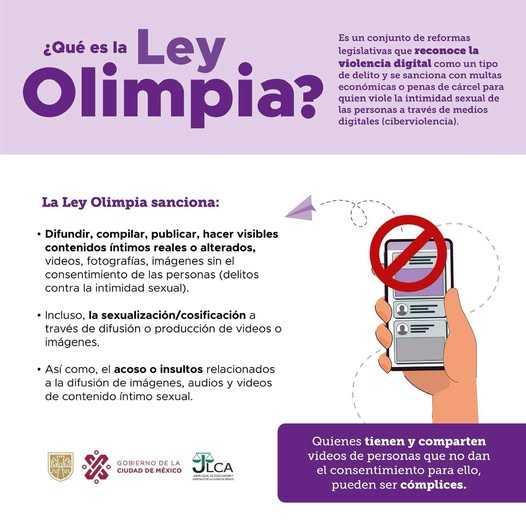

Además, Cantón subraya la importancia de educar a los usuarios sobre cómo identificar y reportar este tipo de imágenes manipuladas. Las víctimas de una imagen sexual creada con IA (o con cualquier otra tecnología) pueden presentar una denuncia penal, una demanda civil, en España pueden acudir a la Agencia Española de Protección de Datos (AEPD) para solicitar la retirada de las imágenes, mientras que en México, puedes llamar a la Policía Cibernética de la Comisión Nacional de Seguridad al 088, que opera las 24 horas del día, los 365 días del año.

En la Ciudad de México, puedes contactar a la Policía Cibernética de la Secretaría de Seguridad Ciudadana al correo [email protected] o al teléfono 55 5242 5100 ext. 5086, activo las 24 horas del día.