Por Diana Soto

Contenidos generados con inteligencia artificial (IA) sobre México como madres que piden ayuda para encontrar a sus hijos o jóvenes que advierten sobre incursionar en el crimen organizado han circulado en redes sociales durante los últimos meses.

Estas escenas no ocurrieron, pero se basan en eventos reales y coyunturales como la caída del líder del Cártel Jalisco Nueva Generación, o manifestaciones como la de la Generación Z, para difundir contenidos que buscan apelar a las emociones, generar pánico o polarizar la discusión política.

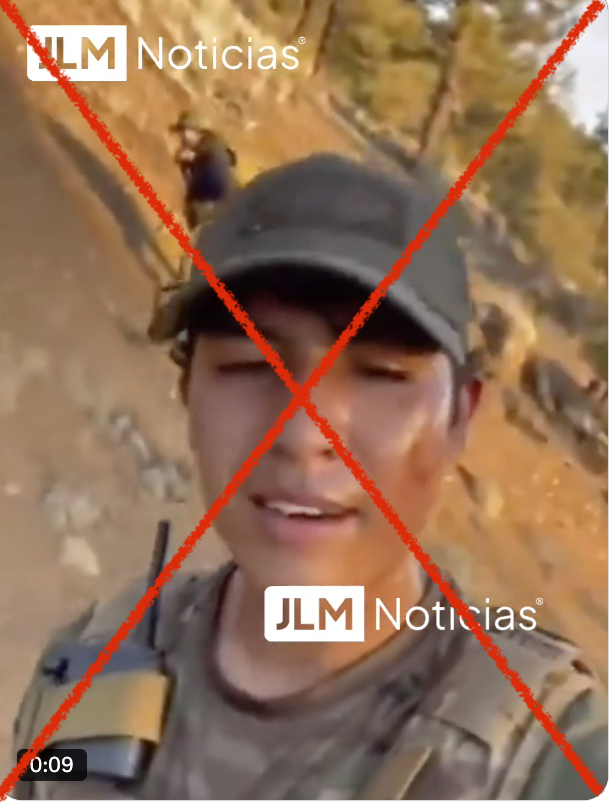

En el caso más reciente, la detención y abatimiento de Nemesio Oseguera Cervantes, alias “El Mencho”, desató contenidos con IA como el video de un joven con ropa de combate, que advertía:

“Mándale este video a tu hijo, carnal. Neta no te alucines. Así andaba yo y mírame, no hay carros, no hay morras, puro miedo por 3 mil pesos. Mejor estudia”, señala el clip en cuyo audio se detectó más de 80% de probabilidades de uso de IA.

El contenido tiene varios detalles que sugieren la aplicación de esta tecnología como la piel extremadamente lisa del joven y la falta de expresiones en el rostro. Sin embargo, el contexto en el que circuló en redes sociales favoreció que obtuviera más de 200 mil visualizaciones y fuera compartido más de 1 mil 400 veces desde el 25 de febrero de 2026, solo en la plataforma X.

Este tipo de fenómenos han sido señalados por portales de verificación, como La Lupa y BBC Verify, como una forma de desinformación emocional, que contempla aquellos contenidos que son difundidos “no por su veracidad, sino porque ilustran una ‘verdad emocional’”.

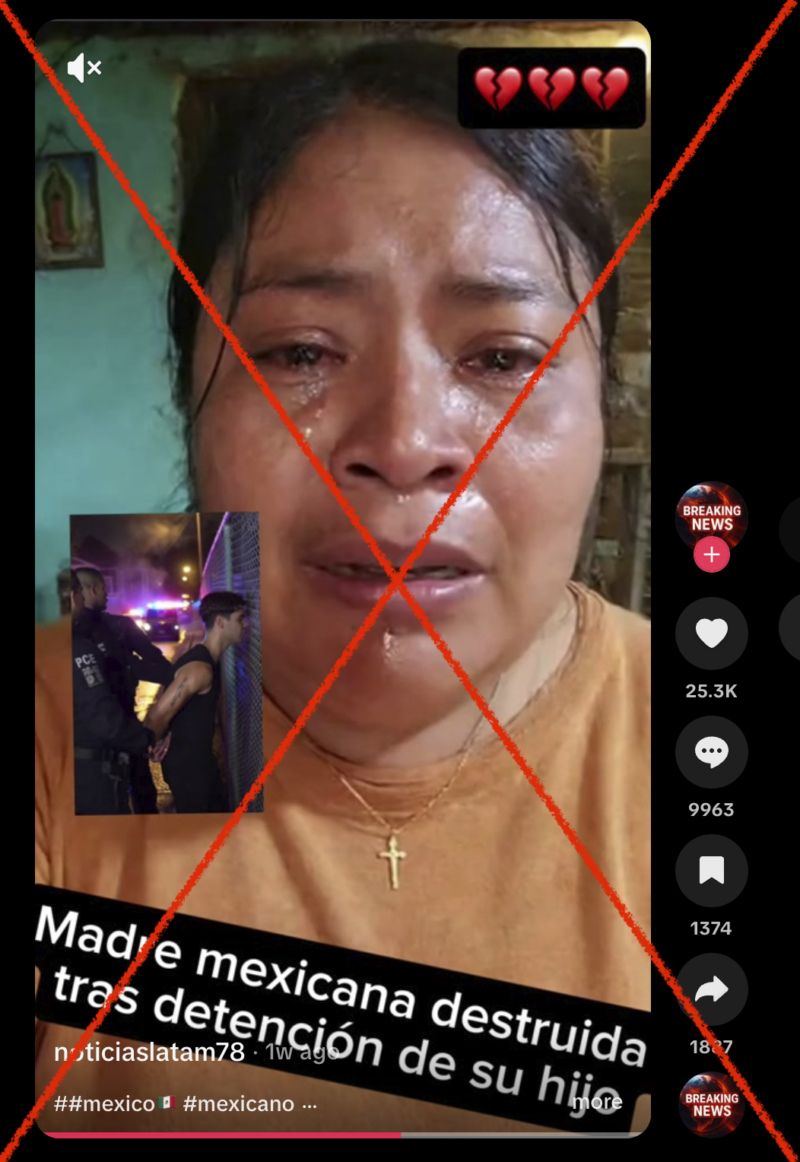

Otro ejemplo de esta desinformación en México ocurrió tras la llamada marcha de la Generación Z. En noviembre de 2025, los clips de madres que pedían ayuda para buscar a sus hijos detenidos durante la protesta superaron las 572 mil reproducciones y los 1 mil 800 compartidos, a pesar de tener amplios indicios de IA.

Cuando Verificado desmintió el video del joven y de la madre, algunos usuarios señalaron que estos contenidos eran notoriamente falsos, pero otros puntualizaron que el uso de IA no implicaba que el hecho no hubiera ocurrido.

Y sí, la particularidad de estos casos es que, tras la captura de “El Mencho”, sí se ha reportado que el crimen organizado pagaba desde 2 mil 500 pesos semanales a sus colaboradores. Y que en la marcha de la Generación Z hubo jóvenes detenidos por las autoridades.

Entonces…¿Por qué se comparten imágenes generadas con IA?

El periodista Mike Wendling de BBC dijo a La Lupa en 2024 que hay personas que defienden estas imágenes por considerarlas argumentos de “una verdad más profunda”. En este sentido, el argumento no se basa en la forma, sino en el contenido.

Sin embargo, la motivación detrás de difundir estos videos no elimina el hecho de que se difunde desinformación. Las publicaciones siguen sin ser grabaciones de personas reales y la viralidad de estos contenidos desvía la atención de otras denuncias reales de madres que buscan a sus hijos o jóvenes que son reclutados por el crimen organizado.

Si bien estos contenidos podrían parecer menos riesgoso que otros tipos de desinformación, su propagación sí tiene la intención de ser recibida por un público que “crea, respalde y comparta” estas narrativas, como lo señala Kelly Fichman, investigadora del departamento de Periodismo y Medios de Comunicación de la Universidad de Galway en un texto para The Conversation.

En el caso del video de la madre, los comentarios se polarizan. Algunos directamente mencionaban la falsedad del video y otros criticaban al gobierno mexicano por reprimir manifestaciones. Todo ello, mientras la publicación acumulaba cada vez más visualizaciones, comentarios y “me gusta”.

En el video del joven que aseguraba haber sido reclutado por el crimen organizado, un usuario escribió: “Es IA, no le quita importancia al mensaje, pero es IA”.

Aunque otros comentarios utilizaron ese espacio para criticar a las víctimas del reclutamiento criminal, programas gubernamentales y hasta el feminismo.

Fichman señala que la conexión de la desinformación con estos grupos se encuentra a través de lo que la socióloga Arlie Russell Hochschild considera “una historia profunda”, narrativas basadas en metáforas con una fuerte carga emocional para ciertas personas.

Además de otros factores como el contexto personal de quienes difunden estos contenidos. En pocas palabras, si las afirmaciones o el video permiten reafirmar sus creencias, valores e ideologías, esas personas lo difundirán.

“El aumento en la disponibilidad de imágenes generadas por IA intensificará aún más su difusión”, explica la investigadora. “Sabemos que las personas están dispuestas a compartir imágenes que saben que son falsas cuando creen que transmiten una ‘verdad emocional’”

Desde esta perspectiva, las imágenes tienen una potente credibilidad de la que se aprovechan los desinformadores para difundir contenido. Sobre todo en una sociedad donde “uno de los problemas más preocupantes de los deepfakes es el deterioro de la confianza pública”, como señala el psicólogo de la UNAM, Daniel Medrano.

Todo esto termina de articularse técnicamente dentro de las redes sociales, en cuyos algoritmos interactúan las cuentas, que aprovechan la coyuntura para obtener las apremiadas interacciones que les permiten monetizar.

FUENTES | LINKS

- Verificación video del supuesto joven del CJNG

- La desinformación emocional generada por IA

- Verificación de videos de madres sobre la marcha de la Generación Z

- La narconómina de “El Mencho”; policías, halcones, maquinitas, todo contabilizado

- Vinculados a proceso tres de los ocho detenidos tras la marcha de la generación Z

- Why people believe misinformation even when they’re told the facts

- The Ecstatic Edge of Politics: Sociology and Donald Trump

- Deepfakes: ¿Cuáles son sus implicaciones sociales y psicológicas como nuevas formas de desinformación?