Por Melina Barbosa (con información de Jeanfreddy Gutiérrez / Efecto Cocuyo)

La Inteligencia Artificial (IA) está siendo instrumentalizada para suplantar a periodistas y noticieros en redes sociales.

La imagen de comunicadores como Carlos Loret de Mola, Damià S. Bonmatí, Jorge Ramos, Pati Chapoy, María Celeste Arrarás y hasta de la vicepresidenta de Venezuela, Delcy Rodríguez ha sido utilizada para difundir información falsa sobre la muerte de políticos.

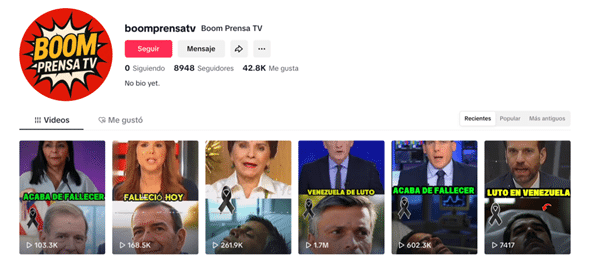

Con apenas seis videos y sin una biografía, el perfil de boomprensatv ya acumula 8 mil 948 seguidores y 42.8 mil me gusta en TikTok, superando las 1.7 millones de visualizaciones en un solo video.

«El presidente de Venezuela, Nicolás Maduro, acaba de fallecer», anuncia el periodista mexicano Carlos Loret de Mola en un video publicado por @boomprensatv.

En otro video de la misma cuenta aparece el periodista Damià S. Bonmatí diciendo “con el corazón en la mano, tenemos que informar la noticia del fallecimiento del ministro de defensa de nuestra querida Venezuela, Vladimir Padrino López”.

Otros TikToks donde figuran los periodistas Jorge Ramos Ávalos, Pati Chapoy y María Celeste Arrarás dan a conocer el fallecimiento de Leopoldo López y Edmundo González Urrutia, opositores al gobierno venezolano de Nicolás Maduro.

Incluso en otro video se ve a la Vicepresidenta de la República Bolivariana de Venezuela, Delcy Rodríguez, anunciando la supuesta muerte del político y excandidato presidencial, Edmundo González.

Pero todo es un engaño, se trata de una cuenta que emplea la Inteligencia Artificial (IA) para suplantar la identidad de periodistas y comunicadores reconocidos para ganar credibilidad y viralizar sus videos desinformantes.

Hasta el momento, no se ha reportado la muerte de Nicolás Maduro, Vladimir Padrino López ni Edmundo González.

El modus operandi de este tipo de cuentas desinformantes

El primer video de esta cuenta desinformante en TikTok fue publicado el 10 de julio de 2025. Desde entonces, muchos usuarios comentaron las publicaciones enviando mensajes de condolencias y/o tachando de desinformadores a los comunicadores, cuya imagen y voz fue creada con Inteligencia Artificial.

Las publicaciones aparentan ser clips o extractos de noticieros televisivos reales para generar confianza entre las personas que lo ven, usando para esto la imagen de periodistas reconocidos para hacer ver más creíble este contenido.

Anteriormente, Cocuyo Chequea, equipo de fact checking venezolano e integrante de LATAM Chequea, identificó esta técnica desinformativa en otras redes sociales, como por ejemplo en YouTube, específicamente con supuestos canales deportivos como @playsportperu y @futboltotal.

Estas cuentas, difundieron desinformación en torno al supuesto paradero del presidente del Consejo Nacional Electoral (CNE), Elvis Amoroso, y la presunta intercepción de un carguero venezolano por parte de Estados Unidos, y para ello, usan imágenes de noticieros descontextualizados con falsas transmisiones en vivo por varias horas.

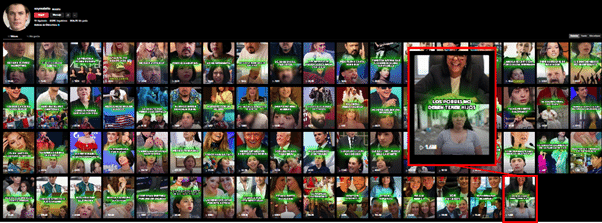

Así mismo, el medio venezolano detectó una red de cuentas con nombres irónicos que, tras publicar falsas declaraciones de Delcy Rodríguez, borraban los videos para ser sustituidos por desinformación de farándula mexicana.

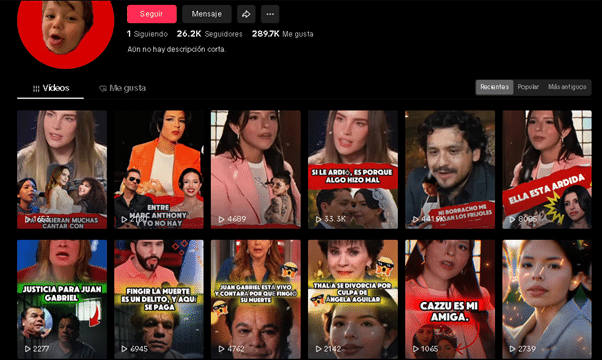

Un ejemplo de esta práctica es Chacarrón TV en la que inicialmente, la vicepresidenta del gobierno de Nicolás Maduro falsamente anunciaba la prohibición del uso del dólar en Venezuela, lo que también hicieron con El Chisme Te Llama y Soy Mulatto, con el falso anuncio de prohibición de “tener más de dos hijos”.

En algunas de estas cuentas también se incluyó la falsa muerte de Nicolás Maduro, así como la de otros políticos venezolanos. En otras ocasiones, usaron nombres de cuentas como ZanahoriaTV y RemolachaTV para distribuir desinformación económica sobre Venezuela y luego borrar los vídeos para ser sustituidos por vídeos de IA con más farándula mexicana.

La cuenta «El Chisme Te Llama» aún está disponible, y tras borrar los videos sobre las muertes de políticos venezolanos, ahora incluye un video en que Nayib Bukele anuncia el encarcelamiento de Juan Gabriel en el CECOT por haber «simulado» su muerte.

Estos canales y cuentas desinformativas emplean titulares llamativos para generar clickbait, una estrategia que garantiza que haya muchas interacciones y visualizaciones en sus contenidos para generar ganancias monetarias.

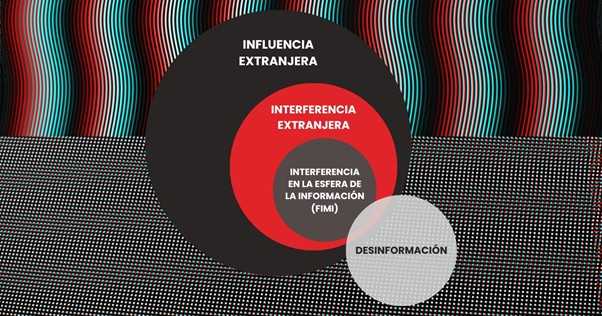

Por otro lado, este tipo de desorden informativo podría ser un indicio de una amenaza de la manipulación de información e interferencia extranjera denominada Foreign Information Manipulation and Interference (FIMI).

FIMI desplaza el enfoque del contenido a los patrones de comportamiento destinados a interferir con la integridad política de los Estados e influir en las decisiones políticas de la región.

Es decir, FIMI es un comportamiento no orgánico que busca manipular la opinión pública a través de diversos canales. Estos actores (estatales o no) suelen explotar más los sentimientos locales.

En todos los casos anteriores, las cuentas de TikTok son de reciente creación, pero sus videos de IA alcanzaron millones de reproducciones y me gusta en horas o pocos días.

Algunas de las cuentas como @lasignaltv, @chacaarroon, @yasurigillette, @soymulatto @elchismetellama1, @iamtukuntazo, @zanahoriateve, @tomateteve, @remolachateve, @lechugateve, @delaguardatv y @boomprensatv, constantemente borran el contenido con desinformación política y lo sustituyen por videos de farándula mexicana, lo que refleja una intención de disimulo y/o aprovechamiento.

Características de las «fake media»

Estas cuentas pueden configurarse también como «fake media«, de acuerdo con el fundador y coordinador del Observatorio Mexicano de Medios, Luis Alberto Martínez, algunas de las características que estos perfiles suelen compartir y que pueden revisarse son:

- Concentran todo su contenido en redes sociales.

- No tienen dominio: El hecho de que tenga un dominio es como tener una dirección postal; esto no significa que no se pueda falsear el domicilio, pero esto indica que una persona por lo menos compró un dominio.

- La naturaleza de las notas es repetitiva en cuanto a temas, personajes, ubicación.

- Tienen alta frecuencia de publicaciones, pero plagian o republican noticias de otros medios o carecen de contenido original.

- No tienen directorio o «caras visibles» de quiénes integran el supuesto medio.

- Las notas, videos o textos no están firmados o no tienen autor.

- Las redes sociales y el portal no tienen conexión directa, es decir, publican diferentes contenidos con diferentes formatos y sin una identidad gráfica definida.

- Las notas no tienen una estructura o estilo similar y el contenido parece o está generado con Inteligencia Artificial.