Especial / La Cadera de Eva

Tus publicaciones no desaparecen. No hay bloqueo ni notificación. Pero de un día para otro, las interacciones caen. Menos vistas, menos respuestas, menos alcance. El contenido sigue ahí. Simplemente, ya no se ve.

En distintos países de América Latina, creadoras de contenido, colectivas, acompañantas de aborto y periodistas feministas comenzaron a notar el mismo patrón en las plataformas. Publican como siempre, pero el alcance cae. Los contenidos siguen visibles en sus perfiles, aunque casi no llegan a nadie. En algunos casos, incluso, sus cuentas de WhatsApp —donde brindan acompañamiento, asesoría y servicios de salud— han sido eliminadas sin previo aviso.

A veces hay una notificación, una advertencia o un mensaje ambiguo. Pero muchas otras veces, no. El contenido no se borra ni se sanciona abiertamente. Solo deja de circular.

Son los algoritmos —los mecanismos que deciden qué se ve y qué no en las plataformas— los que reducen o frenan la visibilidad de ciertos contenidos sin explicaciones claras. A eso se le llama censura algorítmica.

Durante seis meses, con el apoyo de Artículo 19 y la Unión Europea, La Cadera de Eva documentó cómo contenidos sobre derechos sexuales y reproductivos, violencia de género, derechos humanos y la diversidad sexogenérica pierden alcance en redes sociales, y el impacto que esto tiene en el activismo digital y en nuestro derecho a la información.

Los picos de shadowban —la reducción de visibilidad sin notificación— se concentran en fechas clave para el movimiento feminista: el 8 de marzo, Día Internacional de las Mujeres; y el 28 de septiembre, Día de Acción Global por el Aborto Legal, Seguro y Accesible.

Cuando las voces feministas crecen, el alcance cae.

Capitulo 1: Cuando la información que salva vidas se castiga

Fue en 2024. Sin aviso, Meta bloqueó sus cuentas de WhatsApp Business. Cuatro mil conversaciones mensuales, cortadas de golpe. Mujeres en proceso de aborto, perdidas.

«Gente que teníamos en proceso, los perdimos completamente. Nos hizo perder credibilidad y las personas pensaron que no les contestábamos». — Paula Rivera, Telefem

El golpe definitivo llegó meses después: un bloqueo total borró su cuenta de Instagram con 45 mil seguidoras. Años de trabajo, información basada en evidencia científica de la Organización Mundial de la Salud (OMS), eliminados. La razón oficial de Meta nunca llegó.

En México, el aborto inseguro es la cuarta causa de muerte materna. En 2020 la pandemia había convertido hospitales en centros COVID y el acceso a servicios de salud sexual y reproductiva se esfumó. Telefem nació en noviembre de 2021 como respuesta. La organización usa la tecnología para romper barreras, siguiendo los manuales de la OMS y los lineamientos de México que avalan la autogestión del aborto con acompañamiento profesional.

«No es solo médico, es integral. Buscamos dar un apapacho, contención emocional en procesos que generan ansiedad».— Paula Rivera

Pero desde el inicio, Meta rechazó darles certificaciones de seguridad por la temática de su contenido. Las herramientas de comunicación quedaron limitadas antes de empezar. Rivera contrasta: «Me estás censurando por dar un mensaje sanitario… y por otro lado tengo un montón de cosas violentas circulando por todas partes».

Rivera vincula los picos de censura con el clima político. Tras la anulación de Roe v. Wade en Estados Unidos, la vigilancia en los espacios digitales se endureció. Las fronteras físicas y digitales se cerraron al mismo tiempo.

Crearon un blog para desmentir remedios caseros y orientar hacia información y acompañamiento confiable. También migraron a una plataforma española, fuera del ecosistema de Meta, sin que existiera una protección normativa específica que garantizara la permanencia de sus contenidos.

Esa vía tampoco logró sostenerse. La estrategia que sí funcionó fue sacar el mensaje de las plataformas: colocar publicidad sobre la interrupción del embarazo en los vagones exclusivos para mujeres del Metro de la Ciudad de México.

«Aunque nos apaguen el switch, no vamos a claudicar. Nuestro objetivo es evitar que las decisiones reproductivas de las personas les cuesten la vida».— Paula Rivera

A kilómetros de distancia, Miguel Torres vive el mismo patrón. Como coordinador de comunicación de Balance A.C., una organización feminista mexicana que trabaja por la justicia sexual y reproductiva, ha enfrentado al menos dos casos graves de censura por parte de Meta.

El primero fue el bloqueo de la cuenta de Instagram «sentir bueno bonito MX«, dedicada a la educación integral en sexualidad para adolescentes y jóvenes. El argumento: su descripción —que incluía palabras como «sexualidad», «diversidad» y «LGBT+»— infringía las normas comunitarias. Durante dos o tres meses, el perfil dejó de aparecer en búsquedas y recomendaciones. Para recuperar visibilidad, Balance A.C. tuvo que modificar la redacción de su descripción.

El segundo caso ocurrió durante una campaña de prevención de la violencia de género. Aunque la organización entregó toda la documentación requerida por Meta para pautar contenido social y político, la mayoría de sus anuncios fueron rechazados y su cuenta publicitaria fue bloqueada y dada de baja. Más de seis meses sin poder promocionar contenido. Tras un largo proceso de apelaciones lograron reactivarla, pero ahora deben ser especialmente cuidadosos con el lenguaje y las imágenes que utilizan.

«Fue todo un proceso porque primero metimos la queja, (solicitamos) la revisión, porque decíamos: ‘No hay nada malo en la descripción’. Justamente estamos invitando a las personas a disfrutar su sexualidad, a que cojan, y no hay nada de malo en eso. La revisión falló, nos dijeron que seguíamos incumpliendo las normas y que, si no cambiábamos algo, incluso podían bloquear la cuenta. Tuvimos que encontrar maneras distintas de frasear los temas».— Miguel Torres, Balance A.C.

En We R Women On Fire, colectiva dedicada a visibilizar la violencia de género con más de 900 mil seguidoras en Instagram, la censura se presenta como eliminación directa. Magali Vega, embajadora del proyecto, relata que Instagram retira de forma recurrente publicaciones que denuncian casos de feminicidio con nombre y apellido del agresor, bajo el argumento de «incitación al odio».

Lo que comenzó en 2020 como un espacio de ciberactivismo se transformó en una disputa constante con los algoritmos. «Es mucho más fácil que nos bajen el contenido de lo que estamos platicando, que bajen un contenido de los más de dos millones de mercados de explotación sexual que existen actualmente», señala Vega.

El problema se hizo evidente en 2021. Cuando la colectiva empezó a tener más alcance, sus denuncias y videos comenzaron a desaparecer sin explicación. Después, Instagram bloqueó la opción de «seguir» la cuenta, diciendo que el perfil estaba «en revisión». La comunidad dejó de crecer. Para no perder el contacto con mujeres que buscan acompañamiento en procesos judiciales o en la búsqueda de familiares desaparecidos, abrieron una cuenta de respaldo.

La censura también alcanzó a Magali en lo personal: su cuenta fue cerrada cuando empezó a compartir contenidos de la colectiva, bajo el argumento de «avisos de fraude».

La censura se intensifica en fechas clave como el 8 de marzo, el 25 de noviembre o el 28 de septiembre, especialmente en publicaciones sobre marchas, consignas o tendederos de denuncia donde se mencionan responsables o se arroban instituciones.

«La censura algorítmica no es un error aleatorio. Los algoritmos arrastran sesgos, prejuicios y juicios valorativos, y son mucho más permisivos con contenido de entretenimiento o sexualización que con contenido político».— Magali Vega, We R Women On Fire

«Aprendimos a leer el silencio. A veces no te borran: simplemente dejan de mostrarte».— Ana, Michis Aborteros

Saben que hay shadowban cuando las interacciones caen de golpe, los comentarios se detienen y las historias desaparecen hasta para sus seguidoras habituales.

Michis Aborteros nació en 2020, por la urgencia de la pandemia. «Ya no podíamos acompañar de forma presencial… la creación de redes no fue tanto para comunicar, sino para poder acompañar desde los mensajes», explica Ana, quien lleva 10 años como acompañanta de abortos.

La estrategia del nombre no es casual. «Michi» busca quitar peso a una narrativa que siempre ha sido negativa y clandestina. Además, es táctica: desde 2007, las búsquedas de gatos son masivas, y la colectiva decidió «utilizar el algoritmo a nuestro favor» para que el contenido sobre aborto apareciera junto a las fotos de gatitos.

Pero mientras Instagram bloquea opciones de «seguir» en cuentas feministas bajo el argumento de estar «en revisión», las páginas que estafan a mujeres con medicamentos falsos siguen activas aunque las reporten.

Perder cuentas de WhatsApp y redes sociales significa cortar acompañamientos en proceso. «Si se llega a perder esto, podría dejar un acompañamiento a medias o un envío de medicamento de donación a medias… eso es lo que realmente más nos preocupa», dice Ana. Michis Aborteros documentó que organizaciones amigas en Latinoamérica como Fundación MSI han perdido hasta el 80% de sus usuarias por estos bloqueos.

Su primer momento de viralidad fue también el primero de censura. Michis Aborteros se volvió viral después de un llamado en redes sociales sobre el estado del Ángel de la Independencia tras un campeonato de fútbol, comparando la situación con las quejas por la iconoclasia durante marchas feministas.

La publicación fue ampliamente compartida, lo que llevó a que muchas personas entraran a su perfil para insultarlas y acusarlas de promover «asesinatos».

Aprovechando ese alcance, la colectiva modificó el contenido original —ya difundido masivamente, sobre todo por hombres— para incluir información sobre aborto, entre ella el uso seguro de misoprostol con base en datos de la OMS.

Cuando las personas notaron el cambio y la palabra «misoprostol», Meta detectó el contenido y lo marcó como «venta de drogas ilícitas». «Ahí entendimos que ciertas palabras activan algo en el algoritmo», señala Ana.

Durante la pandemia, las ilustraciones, el humor y un lenguaje claro ayudaron a que la información circulara. Llegaba a más gente. Se compartía.

Eso cambió. Cada año, cerca del 8M o del 28S, el alcance se desploma. Las vistas bajan, las interacciones se apagan.

«Es censura», dice Ana.

Capítulo 3: Lo que muestran los datos

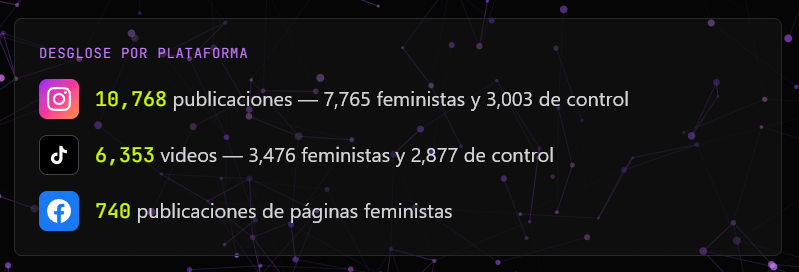

La recolección se realizó sobre contenido público. Las plataformas no permiten el acceso a sus APIs oficiales para este tipo de investigación, así que desarrollamos un método propio para identificar, extraer y analizar los contenidos.

El objetivo no fue demostrar censura directa ni explicar cómo funcionan los algoritmos, sino entender cómo circula el contenido, quién concentra la visibilidad y qué tan fácil —o difícil— es mantener el alcance en cada plataforma. La muestra incluye todas las publicaciones recolectadas por keyword durante el periodo analizado, incluso cuando vienen de una misma cuenta.

Capítulo 3:Algoritmos que no fallan: castigan

Las nuevas políticas de Meta —dueña de Facebook, Instagram y WhatsApp— están dificultando hablar de derechos reproductivos. Contenidos que antes funcionaban ahora se eliminan, se marcan o desaparecen sin explicación. Incluso el Consejo de Supervisión de Meta criticó que la empresa cambió sus reglas sin medir el impacto en derechos humanos.

En TikTok pasa algo distinto: no borran tus videos, pero el algoritmo deja de mostrarlos. Tu contenido se vuelve invisible en «Para ti» sin que sepas por qué ni puedas reclamar.

El resultado: las voces feministas —especialmente cuando hablan de aborto, violencia de género o protesta— sufren castigos invisibles. Menos alcance, más desgaste y menos posibilidad de llegar a quien necesita esa información.

En Facebook, la visibilidad no se reparte igual entre las páginas feministas. Unas pocas organizaciones concentran la mayoría de las publicaciones con más interacciones, mientras que otras —aunque publiquen regularmente— solo logran picos de visibilidad de vez en cuando. Esto no prueba que haya censura directa, pero sí muestra una forma de invisibilización: para que el contenido feminista circule en Facebook no basta con estar activa ni publicar constantemente.

Para Paola Ricaurte, profesora e investigadora del Tecnológico de Monterrey y del Berkman Klein Center de la Universidad de Harvard, esto no es casualidad. Lo que las empresas llaman «moderación de contenido» —las reglas y sistemas, humanos y algorítmicos, que deciden qué se publica, qué se oculta y qué se elimina— funciona en realidad como control político metido en el diseño mismo de estas tecnologías.

«No hay caídas normales de visibilidad. El algoritmo está ajustado para que ciertos contenidos y ciertas características sean siempre visibles».— Paola Ricaurte, investigadora

Y lo que queda fuera de esa lógica se hunde en el silencio digital.

Los algoritmos no son neutros, insiste. Son «sistemas de producción de conocimiento» que aprenden, clasifican y deciden qué se ve en la conversación pública. Su opacidad es a propósito: «Las compañías protegen sus algoritmos como secreto industrial, pero deberían poder auditarse porque están afectando nuestras vidas».

Estas tecnologías, dice Ricaurte, reproducen lógicas patriarcales, centralizadas y opacas que siempre han pisoteado los discursos de derechos.

El problema no es solo en Latinoamérica. A nivel internacional, el reporte Repro Uncensored, publicó en diciembre de 2025 el primer mapa global de la censura contra contenidos sobre derechos sexuales y reproductivos. Temas como el aborto, la diversidad sexual y el trabajo sexual concentran la mayoría de los reportes.

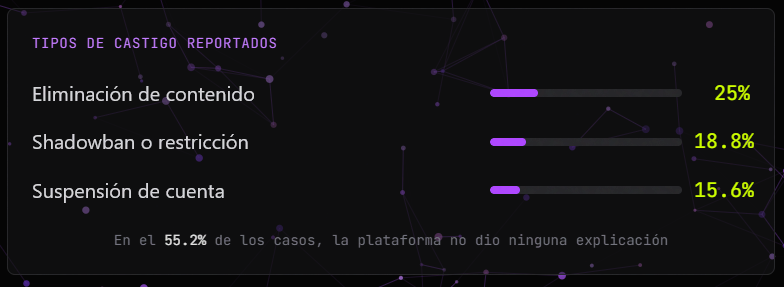

Entre agosto y septiembre de 2025, La Cadera de Eva lanzó un formulario para documentar experiencias de censura algorítmica entre creadoras de contenido, acompañantas de aborto y periodistas feministas. Cuarenta personas respondieron.

Seis de cada diez dijeron que publicar sobre violencia de género activó algún tipo de castigo algorítmico. Ningún otro tema concentra un nivel tan alto de castigos. Le siguen los derechos sexuales y reproductivos, reportados por casi la mitad.

Para muchas creadoras, la censura no es un evento aislado. La eliminación de una publicación suele venir con otras penalizaciones: caída del alcance, suspensión de cuentas o advertencias que afectan la visibilidad futura. En varios casos, las sanciones se acumulan. No es solo perder un post: es perder presencia en la plataforma.

La censura algorítmica no siempre borra: cansa, frena y hace que muchas dejen de publicar y autocensurarse. Casi todas las participantes hablaron de efectos emocionales: frustración, ansiedad y miedo a volver a publicar.

Flor Rodríguez Campos, directora de la asociación civil Repara Lumea que trabaja en la prevención de la violencia sexual en México, señala que el esfuerzo por visibilizar temas sensibles, sumado a la censura y a los comentarios de odio, también provocan un impacto económico. Para muchas organizaciones no empresariales el acceso a medios de difusión es costoso y pocas veces se ven resultados proporcionales. Esta acumulación de obstáculos, advierte, termina por desincentivar y puede llevar incluso a replantearse la continuidad en el activismo.

ALGOSPEAK: Para que el algoritmo no les bloquee el contenido, muchas creadoras y periodistas feministas empezaron a usar algospeak: hablar en clave. Cambian letras, meten números, usan símbolos, emojis o dicen las cosas de otra forma.

«Si son temas de salud, deberían poder nombrarse sin miedo».— Dennise Guerrero, Nuestra Salud Feminista

Lo que más le genera «coraje» es que asuntos fundamentales se invisibilicen desde el propio diseño de los algoritmos y las plataformas.

Para Paola Ricaurte, estos datos no son errores aislados. Las plataformas, dice, están cada vez más alineadas para frenar contenidos sobre derechos, sobre todo en contextos conservadores o autoritarios. Y la moderación no se aplica igual en todos lados: «Cada contexto tiene una aplicación distinta», explica.

En Latinoamérica, los temas más censurados son violencia de género y feminicidios. En Estados Unidos predomina la censura sobre derechos sexuales y reproductivos —sobre todo aborto— y movimientos como Black Lives Matter. En Medio Oriente, o Myanmar, responde a otras dinámicas políticas locales, según la especialista en Inteligencia Artificial.

«Si nosotras no demandamos, no exigimos que exista transparencia, estamos sujetos a la voluntad de un señor que decide cómo tienen que ser nuestras sociedades, nuestras relaciones y nuestras vidas».— Paola Ricaurte

META CAMBIÓ LAS REGLAS SIN MEDIR EL DAÑO

En agosto de 2025, Meta nombró como asesor de Meta AI a Robby Starbuck, conocido por estar en contra de políticas de diversidad. Su rol: quitar supuestos «sesgos políticos» dentro de los sistemas de inteligencia artificial de la compañía.

El informe Meta’s AI Moderation and Free Expression in the Global South, elaborado por el Centre for Media, Technology and Democracy de la Universidad McGill, documenta que la moderación automatizada de Meta sobrerrestringe contenido legítimo en países del Sur Global, especialmente publicaciones sobre derechos humanos, aborto y violencia. El estudio advierte que las lenguas y contextos de regiones como América Latina están subrepresentados en los datos de entrenamiento, lo que deriva en bloqueos y reducciones de alcance desproporcionadas.

Michis Aborteros lo vivió cuando un meme educativo con una pintura renacentista fue marcado como «contenido sexual». Al intentar explicar lo ocurrido en una transmisión en vivo, el video fue cancelado con un mensaje confuso: «este en vivo tiene imágenes borrosas».

Estudios del Oxford Internet Institute y de la Global Investigative Journalism Network muestran que esta «moderación de visibilidad» afecta sobre todo a periodistas, activistas y movimientos sociales. El contenido político no desaparece de inmediato: deja de circular poco a poco, sin dejar rastro ni posibilidad de reclamar.

Para Ricaurte la censura algorítmica es un síntoma estructural de plataformas construidas desde lógicas de control que históricamente han subordinado a las mujeres. «Estas tecnologías son definitivamente patriarcales», dice. «Desde su origen reproducen la mirada del hombre blanco que domina, clasifica y ordena el mundo».

La imagen de Donald Trump rodeado de CEOs tecnológicos durante su toma de posesión en 2025 muestra, para ella, el pacto entre poder político y poder corporativo que sostiene la arquitectura actual del ecosistema digital.

El tecno patriarcado.

Ricaurte propone imaginar una tecnología feminista, comunitaria y basada en el cuidado. Que no busque ser universal ni dominar el espacio digital, sino responder a necesidades concretas, con transparencia en la recolección y uso de datos y con criterios éticos antes que comerciales.

Ejemplo: Legislación española

La reciente legislación española obliga a auditar algoritmos gubernamentales para proteger a las personas de decisiones automatizadas que afectan su acceso a salud, crédito, educación o trabajo.

Para Michis Aborteros, el algoritmo es una extensión del sistema patriarcal que criminaliza los derechos reproductivos en Latinoamérica de forma más agresiva que en otras regiones. Pero la respuesta ha sido colectiva. Han hecho alianzas con madres buscadoras y otras colectivas para compartir estrategias de visibilización y resistencia.

Sin exigir transparencia, los algoritmos reproducen las mismas relaciones de poder que han excluido a las mujeres, concentrando en pocas manos la decisión sobre qué se ve, qué se calla y qué vidas importan.

GUÍA DE DEFENSA COLECTIVA FRENTE A LA CENSURA ALGORÍTMICA

Qué contiene la guía

- Cómo detectar censura algorítmica y shadowban

- Cómo documentar caídas de alcance y penalizaciones invisibles

- Qué hacer cuando una plataforma limita tu contenido

- Prácticas básicas de seguridad y cuidado colectivo

Créditos

Coordinación y Dirección Editorial

Scarlett Lindero Cortés

Investigación

Scarlett Lindero Cortés

Sandra Rojas

Wanda Pacheco

Análisis de datos

Scarlett Lindero Cortés

Visualización de datos

Scarlett Lindero Cortés

César Hernández Ubaldo

César Hernández Ubaldo

Ilustraciones

Eloísa Casanova

Edición de Video

Laura Pavía

Jonathan Vega